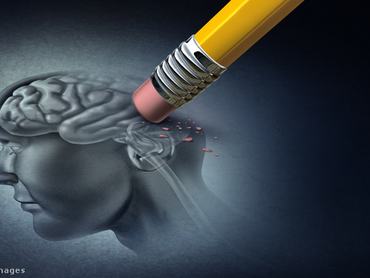

A digitális technológiának köszönhetően ma már könnyen készíthető bárkiről olyan hamis videófelvétel, amit az átlagnéző képtelen megkülönböztetni a valóságtól. Egy új fejlesztés segíthet abban, hogy felismerjük az átveréseket.

Tíz évvel ezelőtt még a photoshopos képmanipulációkon is ámultunk, mára viszont már a technológia olyan szintre lépett, hogy mesterséges intelligencia segítségével bárkiről készülhet a valósághoz a megtévesztésig hasonlító kamuvideó, amit akár komolyabb csalás vagy politikai manipuláció céljaira is felhasználhatnak. A Kaliforniai Egyetem komputertudományi karának végzős hallgatója, Shruti Agarwal annyira aggasztónak találta ezeket a fejleményeket, hogy kifejlesztett egy számítógépes eljárást, amely képes megkülönböztetni egymástól a valóságot és a fikciót – számol be a Neuroscience News.

Szintet lépett a fake news

Az internetes szlengben deepfake-nek nevezett technika lényege, hogy megfelelő algoritmus segítségével a számítógép mesterséges intelligenciája hoz létre hamisított felvételeket. Az egyik népszerű eljárás az ún. face swap, amikor a program valakinek az arcát más testére illeszti. Így jelenhettek meg az interneten például a hírességek „főszereplésével” készített kamupornófilmek.

Szintén gyakori a lip synch, amikor a felvételen látható személy beszéde alá más szöveget szinkronizálnak, a program pedig hozzáigazítja ehhez a szereplő szájmozgását. Ilyen volt az a felvétel, amelyen Barack Obama beszélt utódjáról, Donald Trumpról. A Jordan Peele filmrendező által készített videó hamar elterjedt, de semmi igazságtartalma nem volt.

Az így létrehozott kamufelvételeket nagyon nehéz megkülönböztetni a valóságos videóktól, és a készítésükre kifejlesztett applikációk már bárki számára könnyen hozzáférhetők. Agarwal szerint ez különösen annak fényében riasztó, hogy mennyi álhír és összeesküvés-elmélet terjed a médiában: a fake news olyan méreteket öltött, hogy ténylegesen nem hihetünk a saját szemünknek és fülünknek.

A hallgató és konzulense, Hany Farid informatikaprofesszor szerint azonban a manipulált felvételek, amelyeken két különböző videóanyagot helyeznek egymásra, csak a laikus szem számára illeszkednek tökéletesen, de egy megfelelően alapos vizsgálat és erre a célra kifejlesztett program képes lehet rá, hogy észrevegye a két, egymásra ültetett réteg közötti apró elcsúszásokat. A lip synch videókon például az lehet árulkodó, hogy a manipulált szájmozgás mellett az arc többi része változatlan, a face snap esetében pedig az eredeti arc vonásai mindig átsejlenek valamennyire a ráillesztett maszkon.

Feltérképezték a politikusok nonverbális eszköztárát

Agarwal és Farid öt politikusról – Donald Trumpról, Barack Obamáról, Bernie Sandersről, Hillary Clintonról és Elizabeth Warren szenátorról – válogatott össze videófelvételeket, és végigfuttatták őket az ingyenesen letölthető OpenFace2 nevű mimikafelismerő programon, amely képes listázni a nonverbális jeleket, például a szemöldökrándulásokat, orrcsavarintásokat vagy ajakbiggyesztéseket.

Ennek segítségével elkészítették a politikusok biometrikus modelljét, vagyis fej- és arcmozdulataik kollektív mátrixát. Ezt betáplálva a programba képesek voltak 92-96 százalékos valószínűséggel megállapítani egy adott videóról, hogy valós felvételről vagy deepfake átverésről van-e szó.

A kutatók az általuk kifejlesztett eljárást a kaliforniai Long Beach-en rendezett konferencián mutatták be a nagyközönségnek. A technológia természetesen nem tökéletes – az a legfőbb hibája, hogy a fejlesztés azokat a helyzeteket tudja figyelembe venni, amelyekben a politikusok hivatalos beszédet tartanak, és sokszor használják ugyanazokat a nonverbális mozdulatokat, de ezek nem biztos, hogy egyeznek azzal, ahogy ugyanaz a politikus mondjuk, a családja körében viselkedik. Ettől eltekintve a kifejlesztett eljárás nagy előrelépést jelent, és valóban segíthet megkülönböztetni a valós tartalmakat az álhírektől.