Ha mindenképpen el kell ütnie valakit egy fiatal vagy idős asszonyt választana? A kocsiban utazók sérüljenek inkább vagy a gyalogosok? Segítsen dönteni a kutatóknak!

Évek óta fejlesztik a vezető nélküli járműveket, amik intelligens programjuk és fejlett szenzoraik segítségével sokkal biztonságosabban és kiszámíthatóbban vezetnek, mint az emberek. Nem versenyeznek egymással ok nélkül, nem gurulnak dühbe, nem hoznak irracionális - emberi -döntéseket. Éppen ezért nagy dilemma, hogyan tanítsuk meg őket emberéletek között választani.

Kiszámíthatóbb pályákon már használják, városi közlekedésben még csak tesztüzemben vannak a robotpilóták vezette járművek. A Google projektjeiben már másfél millió mérföldet tettek meg amerikai, városi forgalomban a tesztautók, míg a Delphi Szingapúrban tesztel, a Tesla szintén amerikai utakon, és különböző állami és céges érdekeltségek (Franciaország, Nagy- Britannia, Uber, BMW) pumpálnak egyre több pénzt az iparágba. Nem véletlenül, hiszen az önvezérlő autók nagyságrendekkel biztonságosabbak a hagyományosaknál.

Bár már történt egy halálos kimenetelű baleset önvezető autóval, ez év júniusában (egy Tesla érzékelői az erős ellenfény miatt nem látták az előtte vezető kamion pótkocsiját, a tesztvezető pedig éppen Harry Pottert nézett), azért valljuk be, ez meglehetősen kis szám. Ennek ellenére a média felkapta, a Tesla esett a tőzsdén: egyelőre jobban tartunk tőle, ha a mesterséges intelligencia a „gyilkosunk”, mint ha egy figyelmetlen sofőr. A vállalatoknak tehát minden, de minden alkalmat meg kell ragadni, hogy a balesetek lehetőségét elkerüljék, nem csak humánus, hanem tisztán üzleti érdekekből is. Mégis, előfordulhatnak olyan esetek, akár a szerencsétlen körülmények, akár más vezető, vagy valami természeti katasztrófa miatt, amikor a program biztos lehet benne, hogy valakit meg kell ölnie. Vagy a kocsiban ülőket, vagy a járókelőket. Mégis, hogyan válasszon?

Egy ilyen program számára elsődleges az emberek védelme. Amikor olyan morális probléma elé kerül, amiben emberéletek között kell mérlegelnie, és döntést hoznia, a logikája csődöt mond. Csak úgy taníthatjuk meg neki, ha hagyjuk, hogy elemezze és modellezze azt, ahogy az emberek döntenének. Erre jött létre a Moral Machine.

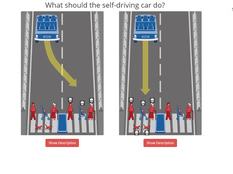

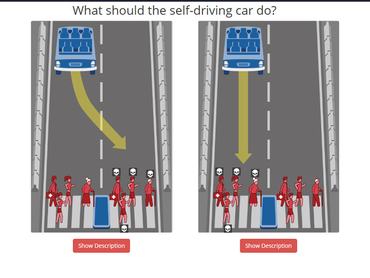

A MIT (Massachusetts Institute of Technology) kutatói által fejlesztett weboldalon 13, feltétlenül halálos kimenetelű balesetben kell az odakattintónak döntést hoznia: kit ölnének meg és kit hagynának életben. Az egyik döntési helyzetben például az autó műszaki hiba miatt képtelen lefékezni, miközben egy gyalogátkelőhely felé hajt. A robotpilótának két lehetősége van: vagy marad a sávjában és elüt egy fiatal nőt a zebrán, vagy elrántja a kormányt, és a szembe lévő sávban haladva egy öregasszonyt gázol el. Ön melyik verziót választaná?

Mind a 13 helyzet elképesztően nehéz, hiszen olyan morális kérdésekben kell döntést hoznunk, ahol minden választásunk csak rossz lehet. Persze a program célja nem az, hogy szorongást keltsen bennünk, hanem, hogy a kutatók összegyűjtsék és kielemezzék az adatokat, majd azokat átadhassák az önvezető autók fejlesztőinek. A kutatás hozama kettős: nemcsak azt lehet belőle leszűrni, hogy az emberek hogyan hoznak döntést, hanem azt is, hogy mit feltételeznek arról, ahogy egy mesterséges intelligencia döntést hoz.